Data di pubblicazione : 15 September 2025

Pubblicato da : Ayushi Sharma

I veicoli autonomi non sono più un concetto futuristico, ma un'intuizione realistica, fortemente guidata dall'intelligenza artificiale (IA) innovativa e da sistemi di sensori all'avanguardia. Entrambi questi componenti lavorano insieme per garantire una navigazione efficiente e la sicurezza. L'IA è diventata la spina dorsale dei veicoli autonomi, facilitando il rilevamento e la percezione. L'IA elabora i dati dei sensori per distinguere e classificare oggetti, come ostacoli, altri veicoli e pedoni, garantendo una navigazione innocua.

L'aspetto del processo decisionale in tempo reale sfrutta prontamente le risorse computazionali di ogni veicolo, ottimizzando i problemi in base alla mobilità del veicolo. A questo proposito, la Science and Information Organization, nel suo rapporto del 2024, ha affermato che questa attività migliora i tempi di reazione di circa il 34% rispetto ad altre tecniche. Inoltre, l'accuratezza della previsione è del 97,8%, il che si traduce in un'effettiva riduzione dei tempi. Inoltre, i veicoli autonomi stanno rapidamente crescendo in complessità e integrando ulteriormente modelli di apprendimento per rinforzo (RL) specifici per il cloud, che si prospettano come una soluzione promettente per potenziare le competenze decisionali.

Qual è il ruolo dell'intelligenza artificiale nei veicoli autonomi?

L'intelligenza artificiale è il cervello dei veicoli autonomi, che consente loro di agire, decidere e percepire in modo simile ai conducenti umani. La transizione verso l'automazione offre maggiore praticità, minori rischi per la salute umana e apre la strada a significativi benefici ambientali ed economici. Come affermato nell'articolo del NLM di dicembre 2024, l'Autopilot di Tesla è stato collegato a 17 decessi e 736 incidenti stradali negli anni precedenti. Tali dati organizzativi hanno evidenziato la necessità imperativa di robustezza nei veicoli autonomi. Ciò si traduce in un funzionamento coerente in diverse circostanze del mondo reale, tra cui condizioni meteorologiche variabili, modelli di traffico complessi e azioni stradali impreviste.

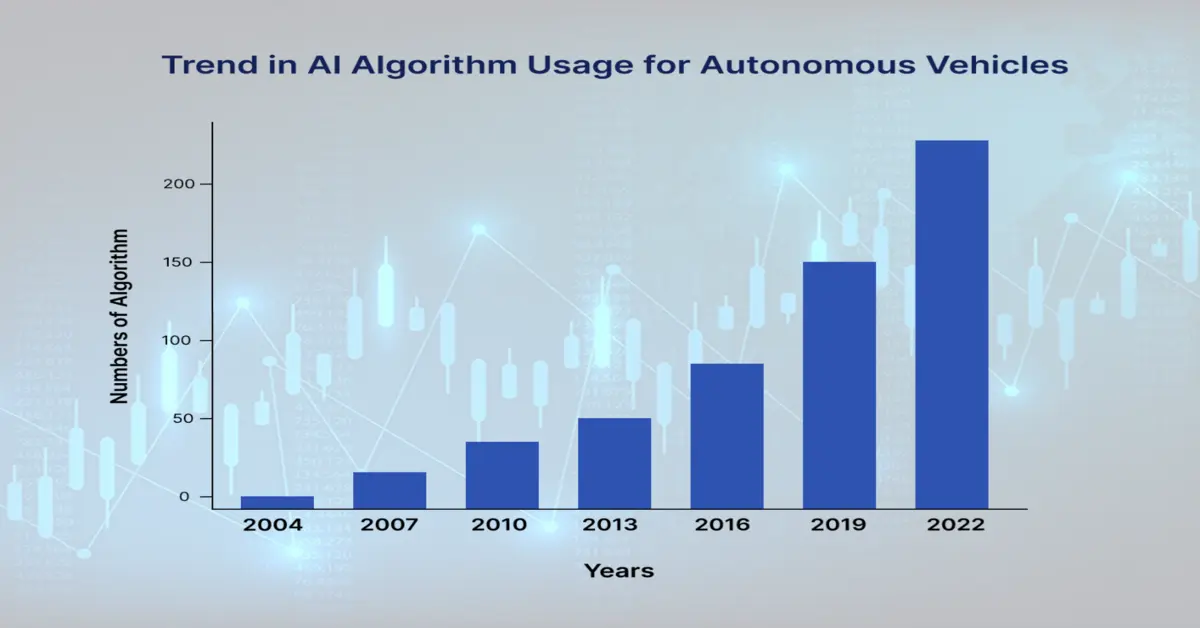

Fonte: MDPI

Apprendimento automatico nei veicoli autonomi

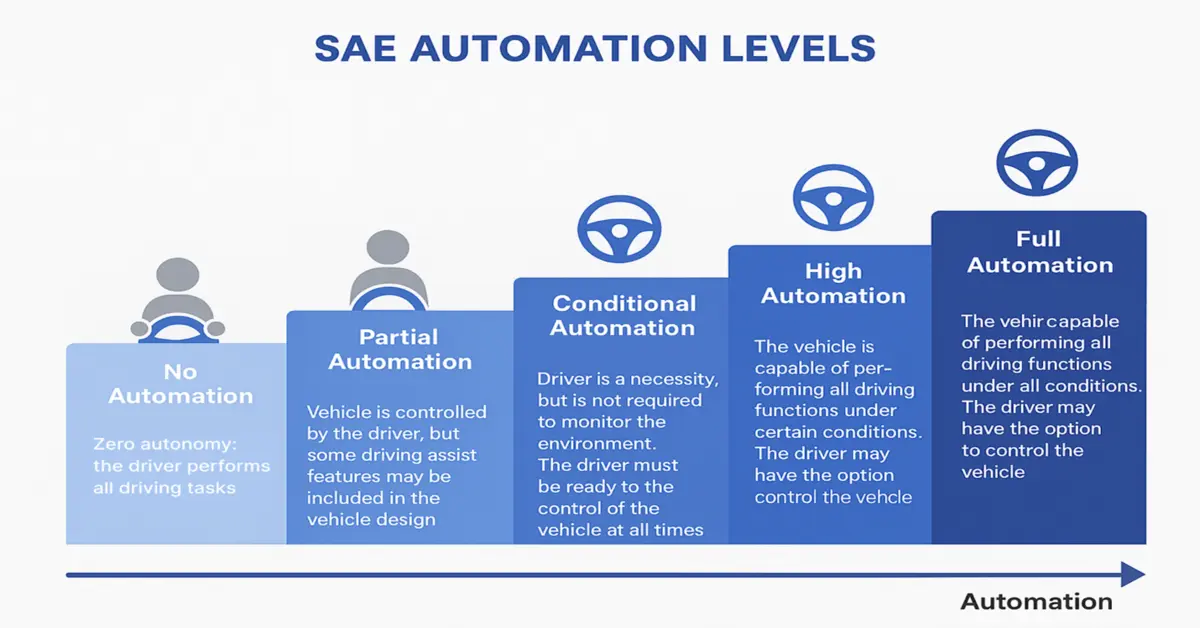

L'apprendimento automatico (ML) è una delle tecnologie di automazione che supportano la progettazione di programmi per computer. Ciò consente di eseguire e completare attività o compiti specifici senza la necessità di intervento umano, ma con il supporto di dati e dispositivi per un determinato periodo di tempo. Secondo un articolo pubblicato da Machine Learning with Applications nel dicembre 2021, si stima che il 94% degli incidenti stradali avvenga a causa di errori dei conducenti, tra cui distrazioni e manovre inadeguate. Inoltre, organizzazioni non automobilistiche e case automobilistiche stanno sviluppando veicoli basati su diversi livelli di automazione, come spiegato dalla Society for Automobile Engineers (SAE) (vedi Figura 1).

Fonte: Science Direct

Visione artificiale per il riconoscimento degli oggetti

L'implementazione di dispositivi di intelligenza artificiale consente di riconoscere segnali stradali, veicoli e pedoni mediante l'impiego di modelli di deep learning, tra cui reti neurali convoluzionali (CNN). Questi modelli supportano ulteriormente la valutazione di video e immagini provenienti da telecamere montate sui veicoli. È qui che entrano in gioco i veicoli autonomi, capaci di garantire la rimozione della foschia, insieme a un robusto sistema di rilevamento e riconoscimento della segnaletica stradale (TSDR). Come affermato nell'articolo dell'MDPI di ottobre 2021, il numero di vittime ha raggiunto quota 1,35 milioni e si stima che ogni anno tra i 20 e i 50 milioni di persone rimangano ferite, aprendo così la strada all'adozione di veicoli autonomi.

Pianificazione del percorso e processo decisionale

Si tratta di funzionalità di intelligenza artificiale essenziali che consentono ai veicoli autonomi di muoversi su strada in modo efficiente e sicuro. Inoltre, l'intelligenza artificiale analizza prontamente i dati raccolti dai sensori in tempo reale utilizzando algoritmi evolutivi per prevedere il percorso ideale, evitando efficacemente gli ostacoli, inclusi pericoli stradali, veicoli e pedoni. Inoltre, tecniche innovative come il Model Predictive Control (MPC) offrono accelerazione livellata, modifiche di corsia e frenata. Infine, la clonazione interattiva consente all'intelligenza artificiale di acquisire conoscenze dagli schemi di guida umani e di imitare con successo le decisioni degli esperti in situazioni complesse.

Sensori critici che alimentano le auto a guida autonoma

I veicoli autonomi dipendono sempre più da una serie di sensori non convenzionali per osservare l'ambiente circostante, ognuno dei quali svolge un ruolo esclusivo nel supportare capacità di guida autonoma efficienti e sicure. Questi sensori operano in tandem per sviluppare una comprensione approfondita dello sfondo del veicolo, confermando il processo decisionale in tempo reale. Di seguito sono riportati alcuni sensori chiave, insieme alle loro funzioni, vantaggi e limiti.

- LiDAR (Light Detection and Ranging): utilizza impulsi laser ottici per produrre mappe 3D ad alta risoluzione di un veicolo, consentendo l'identificazione dettagliata di oggetti, ostacoli e curvature stradali. La sua precisione centimetrica lo rende essenziale per una mappatura ambientale completa. Secondo il rapporto McKinsey di gennaio 2023, il prezzo dei veicoli autonomi con funzionalità LiDAR di Livello 2+ varia tra 1.500 e 2.000 dollari, il che li rende costosi. Tuttavia, il mercato LiDAR continua a crescere con una valutazione di 3,3 miliardi di dollari nel 2025, secondo un rapporto di Research Nester .

- Radar (Radio Detection and Ranging): questo sistema è in grado di identificare la distanza e la velocità degli oggetti sfruttando le onde radio, rendendolo essenziale per la prevenzione delle collisioni e il cruise control adattivo. Rispetto alle telecamere e al LiDAR, il radar funziona efficacemente in condizioni di scarsa visibilità, come polvere, pioggia e nebbia, grazie alla sua lunghezza d'onda elevata. Inoltre, i sistemi radar 4D avanzati, come quelli di Arbe Robotics, si concentrano sul miglioramento della risoluzione, elevando i dati e potenziando la classificazione degli oggetti.

- Telecamere (Computer Vision-Based Perception): forniscono dati visivi ingranditi, fondamentali per il rilevamento di pedoni, segnaletica orizzontale e stradale attraverso reti neurali convoluzionali (CNN). Ad esempio, il sistema Full Self-Driving (FSD) di Tesla dipende fortemente da 8 telecamere circostanti per ottenere una percezione a 360 gradi. Inoltre, secondo uno studio condotto dall'IEEE nel 2023, condizioni meteorologiche avverse, come l'aumento della pioggia, riducono la precisione di identificazione degli oggetti tramite telecamera di quasi il 40% a 80 mm/h, evidenziando così la necessità di una fusione di sensori per i veicoli autonomi.

- Sensori a ultrasuoni: utilizzano onde sonore per capacità di rilevamento a corto raggio fino a 5 metri, il che li rende adatti per manovre a bassa velocità e per l'assistenza al parcheggio. Sono estremamente convenienti e costituiscono prestazioni standard in qualsiasi condizione meteorologica. Tuttavia, questi sensori hanno una portata limitata che ne limita le funzioni supplementari. Inoltre, secondo un rapporto pubblicato da Bosch nel 2024, i sensori a ultrasuoni sono installati in oltre l'80% dei veicoli più recenti dotati di sistemi ADAS, a dimostrazione della loro ampia diffusione per il rilevamento prossimale.

Come l'intelligenza artificiale elabora i dati dei sensori in tempo reale?

I veicoli autonomi si affidano all'intelligenza artificiale per comprendere e reagire di conseguenza ai dati dei sensori in pochi millisecondi, più rapidamente dei conducenti umani. Combinando gli sforzi di numerosi sensori e integrando algoritmi all'avanguardia, l'intelligenza artificiale ha garantito un processo decisionale preciso e in tempo reale, fondamentale per la sicurezza.

Sensor Fusion: combinazione di più flussi di dati

Un singolo sensore, in generale, non fornisce una conoscenza ambientale completa, quindi l'intelligenza artificiale combina dati provenienti da ultrasuoni, telecamere, radar e LiDAR per superare le singole limitazioni. Ad esempio, mentre il LiDAR fornisce una mappatura 3D dettagliata, le telecamere offrono dettagli circostanziali, inclusi i colori dei semafori. Inoltre, secondo un articolo pubblicato dal Dipartimento dei Trasporti degli Stati Uniti nel 2022, la fusione dei sensori può ridurre l'errata classificazione degli oggetti di quasi il 60% rispetto ai sistemi a sensore singolo.

Tempo di risposta dell'IA rispetto al tempo di reazione umano

Secondo il rapporto NHTSA del 2021, l'intelligenza artificiale elabora efficacemente i dati e gestisce i pericoli in 100-200 millisecondi, mentre i conducenti umani impiegano in media 1,5 secondi in caso di emergenza. Inoltre, secondo uno studio pubblicato dall'IIHS nel giugno 2020, è stato dimostrato che i veicoli autonomi, dotati di fusione di sensori, possono superare circa il 34% delle collisioni e oltre 5.000 incidenti causati da reazioni umane differite. Inoltre, la National Science Foundation nel 2023 ha osservato che l'innovazione nell'edge computing consente attualmente ai veicoli autonomi di prendere decisioni più rapidamente rispetto ai modelli precedenti, denotando così un significativo miglioramento nella prevenzione delle collisioni.

Il futuro dell'intelligenza artificiale e della tecnologia dei sensori nei veicoli autonomi

Il prossimo decennio vedrà una trasformazione radicale nella tecnologia dei veicoli autonomi, in gran parte dovuta alle innovazioni apportate dai sensori e dai sistemi di intelligenza artificiale. A questo proposito, due sviluppi cruciali modificheranno radicalmente l'evoluzione:

- Il ruolo del 5G e del V2X (Vehicle-to-Everything): la comunicazione V2X e le reti 5G sono pronte a fornire uno scambio di dati in tempo reale tra infrastrutture stradali, semafori e veicoli, riducendo la dipendenza dai sensori di bordo. Nell'aprile 2023, il Dipartimento dei Trasporti degli Stati Uniti ha stimato che il V2X potrà prevenire quasi 615.000 incidenti ogni anno entro la fine del 2030. Inoltre, nel 2022, la 5G Automotive Association ha segnalato una latenza inferiore a 1 millisecondo, che ha consentito un allarme immediato del rischio, un fattore ancora più significativo per l'autonomia ad alta velocità.

- Arrivo dell'autonomia di Livello 5: attualmente, Cruise e Waymo operano deliberatamente sulla base di prototipi di Livello 4, per cui la maggior parte degli esperti prevede un'implementazione diffusa del Livello 5 entro il 2030 e il 2035. Inoltre, secondo il rapporto AAA di febbraio 2025, quasi il 13% degli automobilisti negli Stati Uniti preferisce i veicoli a guida autonoma, con un aumento rispetto al 9% degli anni precedenti. Tuttavia, come affermato nel rapporto McKinsey di agosto 2023, il 95% dei veicoli più recenti sarà commercializzato entro il 2030, di cui il 12% sarà dotato di veicoli autonomi di Livello 3 o Livello 4.

La strada da percorrere per i veicoli autonomi guidati dall'intelligenza artificiale

I veicoli autonomi rappresentano una straordinaria sintesi di intelligenza artificiale e precisione dei sensori, operando in sinergia per distinguere, scegliere e dirigere la strada. Tuttavia, nonostante i rapidi progressi, il raggiungimento della tecnologia di guida autonoma rimane un percorso continuo. Questo comporta sfide, tra cui il perdurare dello scetticismo pubblico, ostacoli normativi e scenari limite. Sebbene l'intelligenza artificiale abbia il potenziale per strade innocue e più ben organizzate, l'evoluzione verso l'autonomia complessiva richiede una rivoluzione continua e un cambiamento sociale. Mentre ci troviamo al bivio di questa rivoluzione dei trasporti, una domanda rimane: speri in un'auto che si guida da sola o sei ancora a favore del controllo umano? La risposta potrebbe plasmare il futuro della mobilità.

Contattaci