Veröffentlichungsdatum : 15 September 2025

Verfasst von : Ayushi Sharma

Autonome Fahrzeuge sind längst keine Zukunftsvision mehr, sondern Realität geworden. Innovative künstliche Intelligenz (KI) und fortschrittliche Sensorsysteme treiben diese Entwicklung voran. Beide Komponenten arbeiten zusammen, um effiziente Navigation und Sicherheit zu gewährleisten. KI bildet das Rückgrat autonomer Fahrzeuge, indem sie die Erfassung und Wahrnehmung von Umgebungen ermöglicht. Sie verarbeitet Sensordaten, um Objekte wie Hindernisse, andere Fahrzeuge und Fußgänger zu unterscheiden und zu klassifizieren und so eine sichere Navigation zu gewährleisten.

Die Echtzeit-Entscheidungsfindung nutzt die in jedem Fahrzeug vorhandenen Rechenressourcen optimal, um Probleme basierend auf der Fahrzeugmobilität zu optimieren. Die Science and Information Organization (SIO) stellte in ihrem Bericht von 2024 fest, dass diese Methode die Reaktionszeit im Vergleich zu anderen Verfahren um etwa 34 % verkürzt. Darüber hinaus liegt die Vorhersagegenauigkeit bei 97,8 %, was zu einer effektiven Zeitersparnis führt. Autonome Fahrzeuge werden zudem immer komplexer und integrieren zunehmend Cloud-basierte Reinforcement-Learning-Modelle (RL), was eine vielversprechende Lösung zur Steigerung der Entscheidungsfähigkeit darstellt.

Welche Rolle spielt künstliche Intelligenz bei autonomen Fahrzeugen?

Künstliche Intelligenz (KI) ist das zentrale Steuerungselement autonomer Fahrzeuge und ermöglicht es ihnen, ähnlich wie menschliche Fahrer zu handeln, Entscheidungen zu treffen und ihre Umgebung wahrzunehmen. Der Übergang zur Automatisierung bietet mehr Komfort, verringert die Risiken für den Menschen und eröffnet Möglichkeiten für erhebliche ökologische und ökonomische Vorteile. Wie im NLM-Artikel vom Dezember 2024 erwähnt, wurde Teslas Autopilot in den vergangenen Jahren mit 17 Todesfällen und 736 Unfällen in Verbindung gebracht. Diese Daten unterstreichen die dringende Notwendigkeit der Robustheit autonomer Fahrzeuge. Dies gewährleistet einen zuverlässigen Betrieb unter verschiedensten realen Bedingungen, darunter wechselnde Wetterverhältnisse, komplexe Verkehrssituationen und unerwartete Fahrmanöver.

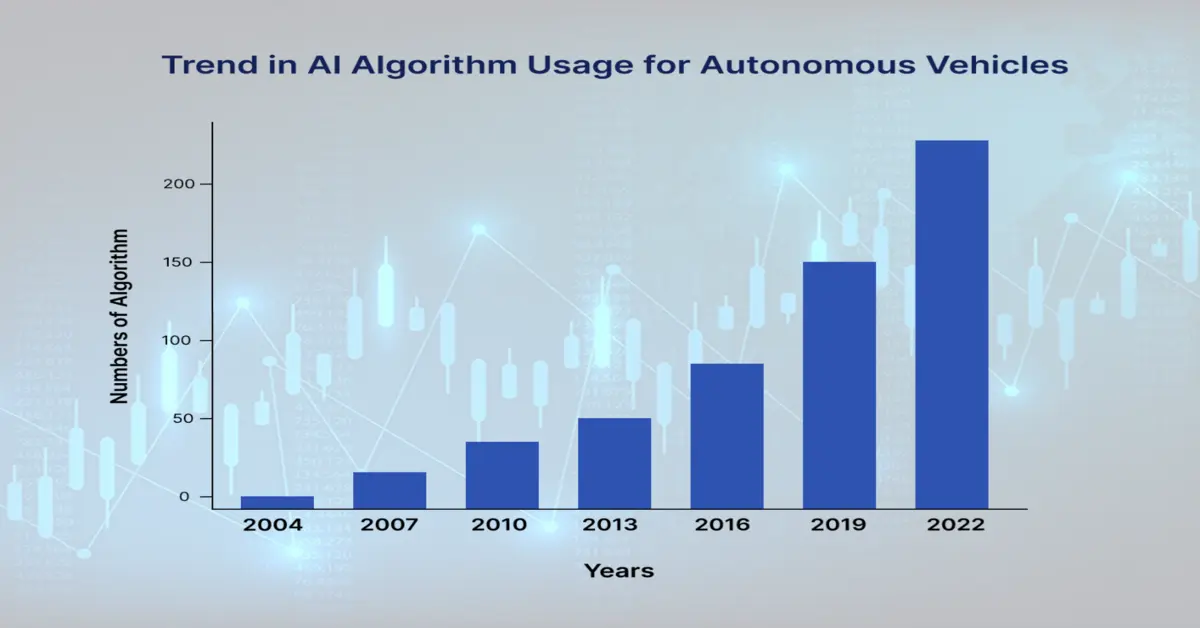

Quelle: MDPI

Maschinelles Lernen in autonomen Fahrzeugen

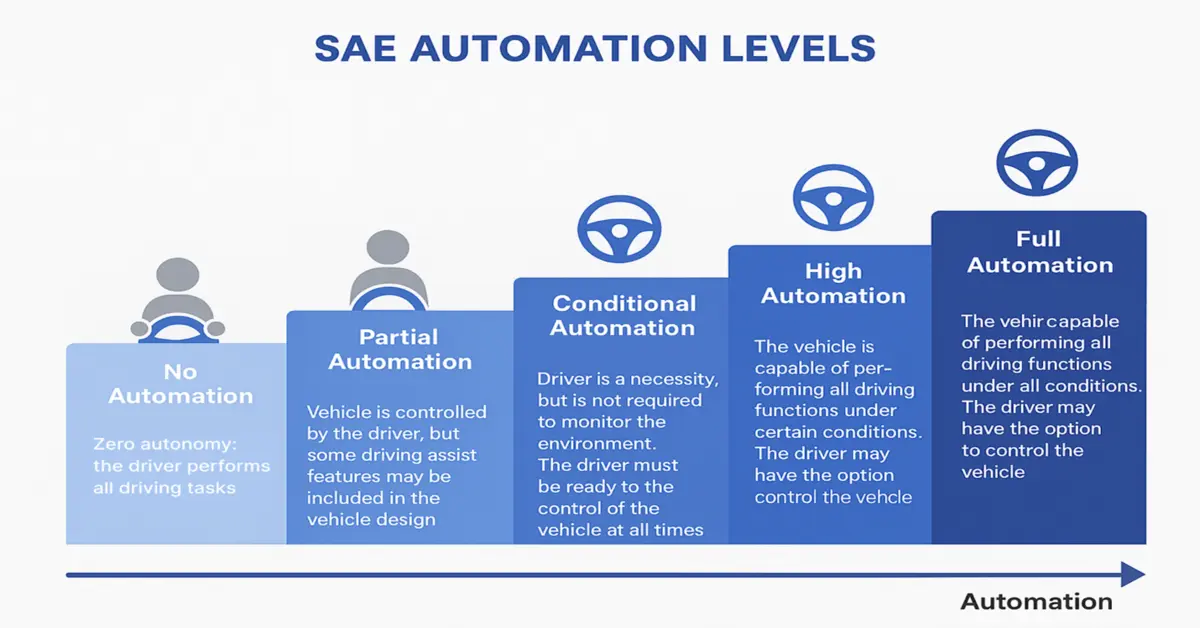

Maschinelles Lernen (ML) ist eine der Automatisierungstechnologien, die bei der Entwicklung von Computerprogrammen helfen. Dadurch können bestimmte Aktivitäten oder Aufgaben ohne menschliches Eingreifen, aber mithilfe von Daten und Geräten über einen bestimmten Zeitraum hinweg, ausgeführt und abgeschlossen werden. Laut einem Artikel, der im Dezember 2021 in der Fachzeitschrift „Machine Learning with Applications“ veröffentlicht wurde, sind schätzungsweise 94 % aller Verkehrsunfälle auf Fahrfehler zurückzuführen, darunter Ablenkung und ungeeignete Fahrmanöver. Darüber hinaus entwickeln auch branchenfremde Organisationen und Automobilhersteller Fahrzeuge mit unterschiedlichen Automatisierungsgraden, wie die Society for Automobile Engineers (SAE) erläutert (siehe Abbildung 1).

Quelle: Science Direct

Computer Vision zur Objekterkennung

Der Einsatz von KI-Geräten ermöglicht die Erkennung von Verkehrszeichen, Fahrzeugen und Fußgängern mithilfe von Deep-Learning-Modellen, darunter Convolutional Neural Networks (CNNs). Diese Modelle unterstützen zudem die Auswertung von Videos und Bildern, die von an Fahrzeugen montierten Kameras aufgenommen wurden. Hier kommen autonome Fahrzeuge ins Spiel: Sie gewährleisten die Beseitigung von Smog und eine zuverlässige Verkehrszeichenerkennung. Wie ein MDPI-Artikel vom Oktober 2021 berichtet, hat die Zahl der Todesopfer durch Verkehrsunfälle die 1,35-Millionen-Marke erreicht, und schätzungsweise 20 bis 50 Millionen Menschen werden jährlich verletzt. Dies ebnet den Weg für die Einführung autonomer Fahrzeuge.

Pfadplanung und Entscheidungsfindung

Dies sind essenzielle KI-Funktionen, die es autonomen Fahrzeugen ermöglichen, effizient und sicher im Straßenverkehr zu navigieren. Darüber hinaus analysiert die KI mithilfe fortschrittlicher Algorithmen Echtzeit-Sensordaten, um die optimale Route vorherzusagen und Hindernissen wie Gefahrenstellen, anderen Fahrzeugen und Fußgängern zuverlässig auszuweichen. Innovative Verfahren wie die modellprädiktive Regelung (MPC) ermöglichen zudem gleichmäßiges Beschleunigen, Spurwechsel und Bremsen. Interaktives Klonen erlaubt es der KI außerdem, von menschlichen Fahrmustern zu lernen und in komplexen Situationen Expertenentscheidungen erfolgreich nachzuahmen.

Wichtige Sensoren für selbstfahrende Autos

Autonome Fahrzeuge nutzen zunehmend eine Vielzahl unkonventioneller Sensoren zur Umgebungsbeobachtung. Jeder Sensor trägt auf seine Weise zu effizienten und sicheren Fahrfunktionen bei. Die Sensoren arbeiten zusammen, um ein umfassendes Verständnis der Fahrzeugumgebung zu entwickeln und so Echtzeit-Entscheidungen zu ermöglichen. Im Folgenden werden einige wichtige Sensoren sowie ihre Funktionen, Vorteile und Grenzen beschrieben.

- LiDAR (Light Detection and Ranging): Dieses Verfahren nutzt optische Laserimpulse, um hochauflösende 3D-Karten eines Fahrzeugs zu erstellen. Dadurch können Objekte, Hindernisse und Straßenkrümmungen detailliert erkannt werden. Die zentimetergenaue Präzision macht es für eine umfassende Kartierung der Umgebung unerlässlich. Laut einem McKinsey-Bericht vom Januar 2023 liegen die Preise für autonome Fahrzeuge mit LiDAR-basierter Level-2+-Technologie zwischen 1.500 und 2.000 US-Dollar, was sie relativ teuer macht. Der LiDAR-Markt wächst jedoch weiter und wird laut einem Bericht von Research Nester im Jahr 2025 einen Wert von 3,3 Milliarden US-Dollar erreichen.

- Radar (Radio Detection and Ranging): Dieses Verfahren ist besonders effektiv bei der Bestimmung von Entfernung und Geschwindigkeit von Objekten durch den Einsatz von Radiowellen und daher unverzichtbar für Kollisionsvermeidung und adaptive Geschwindigkeitsregelung. Im Vergleich zu Kameras und LiDAR arbeitet Radar dank seiner langen Wellenlänge auch bei schlechten Sichtverhältnissen wie Staub, Regen und Nebel zuverlässig. Moderne 4D-Radarsysteme, wie beispielsweise von Arbe Robotics, verbessern die Auflösung durch eine höhere Datenqualität und eine optimierte Objektklassifizierung.

- Kameras (Computer Vision-basierte Wahrnehmung): Diese liefern vergrößerte visuelle Daten, die für die Erkennung von Fußgängern, Fahrbahnmarkierungen und Verkehrszeichen mithilfe von Convolutional Neural Networks (CNNs) unerlässlich sind. Beispielsweise ist das Full Self-Driving (FSD)-System von Tesla stark von acht umlaufenden Kameras abhängig, um eine 360-Grad-Erkennung zu gewährleisten. Laut einer IEEE-Studie aus dem Jahr 2023 verringert starkes Wetter, wie etwa heftiger Regen, die Genauigkeit der kameraspezifischen Objekterkennung bei einer Regengeschwindigkeit von 80 mm/h um fast 40 %. Dies unterstreicht die Notwendigkeit der Sensorfusion für autonome Fahrzeuge.

- Ultraschallsensoren: Diese Sensoren nutzen Schallwellen zur Nahbereichserkennung bis zu 5 Metern und eignen sich daher für Fahrmanöver bei niedrigen Geschwindigkeiten sowie für Einparkhilfen. Sie sind äußerst kostengünstig und bieten unter allen Wetterbedingungen Standardleistung. Allerdings ist ihre Reichweite begrenzt, was ihre Einsatzmöglichkeiten einschränkt. Laut einem Bericht von Bosch aus dem Jahr 2024 sind Ultraschallsensoren in über 80 % der neuesten Fahrzeuge mit Fahrerassistenzsystemen (ADAS) verbaut, was ihre weite Verbreitung in der Nahbereichserkennung unterstreicht.

Wie verarbeitet KI Sensordaten in Echtzeit?

Autonome Fahrzeuge sind auf künstliche Intelligenz angewiesen, um Sensordaten innerhalb von Millisekunden zu verstehen und entsprechend zu reagieren – deutlich schneller als menschliche Fahrer. Durch die Kombination der Daten zahlreicher Sensoren und die Integration modernster Algorithmen ermöglicht KI präzise Entscheidungen in Echtzeit, die für die Sicherheit unerlässlich sind.

Sensorfusion: Kombination mehrerer Datenströme

Einzelne Sensoren liefern im Allgemeinen kein umfassendes Umgebungsbild. Daher kombiniert KI Daten von Ultraschall, Kameras, Radar und LiDAR, um die jeweiligen Einschränkungen zu überwinden. LiDAR ermöglicht beispielsweise detaillierte 3D-Kartierungen, während Kameras Umgebungsdetails wie Ampelfarben erfassen. Laut einem Artikel des US-Verkehrsministeriums aus dem Jahr 2022 kann die Sensorfusion die Fehlklassifizierung von Objekten im Vergleich zu Systemen mit nur einem Sensor um fast 60 % reduzieren.

Reaktionszeit der KI im Vergleich zur menschlichen Reaktionszeit

Laut einem Bericht der NHTSA aus dem Jahr 2021 verarbeitet KI Daten effektiv und reagiert innerhalb von 100 bis 200 Millisekunden auf Gefahren, während menschliche Fahrer im Notfall durchschnittlich 1,5 Sekunden benötigen. Eine im Juni 2020 vom IIHS veröffentlichte Studie belegt zudem, dass autonome Fahrzeuge mit Sensorfusion etwa 34 % der Kollisionen und über 5.000 Unfälle, die durch verzögerte menschliche Reaktionen verursacht wurden, vermeiden können. Darüber hinaus stellte die National Science Foundation 2023 fest, dass Innovationen im Bereich Edge Computing autonomen Fahrzeugen ermöglichen, Entscheidungen deutlich schneller zu treffen als frühere Modelle, was eine signifikante Verbesserung der Kollisionsvermeidung bedeutet.

Die Zukunft von KI und Sensortechnologie in autonomen Fahrzeugen

Das kommende Jahrzehnt wird einen tiefgreifenden Fortschritt in der Technologie autonomer Fahrzeuge mit sich bringen, der maßgeblich auf Revolutionen bei Sensor- und KI-Systemen zurückzuführen ist. In diesem Zusammenhang werden zwei entscheidende Entwicklungen die Evolution maßgeblich beeinflussen:

- Die Rolle von 5G und V2X (Vehicle-to-Everything): V2X-Kommunikation und 5G-Netze ermöglichen den Datenaustausch in Echtzeit zwischen Straßeninfrastruktur, Ampeln und Fahrzeugen und reduzieren so die Abhängigkeit von fahrzeuginternen Sensoren. Das US-Verkehrsministerium schätzte im April 2023, dass V2X bis Ende 2030 jährlich fast 615.000 Unfälle verhindern kann. Darüber hinaus berichtete die Automotive Association (AAA) im Jahr 2022 von einer Latenz von unter einer Millisekunde, was eine sofortige Gefahrenwarnung ermöglicht – ein entscheidender Vorteil für autonomes Fahren bei hohen Geschwindigkeiten.

- Einführung von Autonomie der Stufe 5: Cruise und Waymo setzen derzeit bewusst auf Prototypen der Stufe 4. Daher prognostizieren die meisten Experten eine breite Einführung von Stufe 5 zwischen 2030 und 2035. Laut einem AAA-Bericht vom Februar 2025 bevorzugen in den USA bereits fast 13 % der Autofahrer selbstfahrende Fahrzeuge – ein Anstieg gegenüber 9 % in den Vorjahren. Einem McKinsey-Bericht vom August 2023 zufolge werden bis 2030 95 % der neuesten Fahrzeuge auf den Markt kommen, davon 12 % mit Autonomie der Stufen 3 oder 4.

Der Weg in die Zukunft für KI-gesteuerte autonome Fahrzeuge

Autonome Fahrzeuge verkörpern eine außergewöhnliche Synthese aus KI-Intelligenz und präziser Sensorik, die insbesondere beim Erkennen, Auswählen und Steuern der Straße harmonisch zusammenwirkt. Trotz rasanter Fortschritte ist die Entwicklung autonomer Fahrtechnologie jedoch noch lange nicht abgeschlossen. Dies birgt Herausforderungen wie anhaltende Skepsis in der Öffentlichkeit, regulatorische Hürden und Grenzfälle. KI hat zwar das Potenzial für sicherere und besser organisierte Straßen, doch die Entwicklung hin zur vollständigen Autonomie erfordert weiterhin grundlegende Veränderungen und gesellschaftliche Anpassungen. Am Wendepunkt dieser Verkehrswende bleibt eine Frage: Wünschen Sie sich ein Auto, das von selbst fährt, oder bevorzugen Sie weiterhin die menschliche Steuerung? Die Antwort könnte die Zukunft der Mobilität prägen.

Kontaktieren Sie uns